خلاف متصاعد بشأن القيود الأخلاقية على نموذج «كلود» داخل أنظمة الدفاع والاستخبارات

واشنطن – 23 فبراير 2026 المنشر الإخبارى

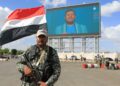

في تصعيد لافت يكشف حجم التوتر بين المؤسسة العسكرية الأمريكية وشركات الذكاء الاصطناعي، استدعى وزير الحرب الأمريكي بيت هيغسيث الرئيس التنفيذي لشركة أنثروبيك داريو أمودي إلى مقر وزارة الحرب الأمريكية لعقد اجتماع وُصف بأنه “غير ودي”، وذلك على خلفية الخلاف بشأن استخدام نموذج الذكاء الاصطناعي «كلود» داخل الأنظمة العسكرية المصنفة سرّيًا.

الخلاف يتمحور حول الشروط التي تضعها الشركة لاستخدام نموذجها في البيئات الدفاعية الحساسة. ووفق مصادر مطلعة، يُعد «كلود» حاليًا النموذج الأكثر تقدمًا المتاح داخل الأنظمة العسكرية السرية، ويُستخدم في تطبيقات تتعلق بالتحليل الاستخباراتي ومعالجة البيانات المعقدة.

صدام حول القيود الحساسة

وزارة الحرب لا ترغب في فقدان الوصول إلى النموذج، لكنها تضغط لإزالة ما تعتبره قيودًا تحد من الاستفادة الكاملة من قدراته. في المقابل، تبدي الشركة استعدادًا لتخفيف بعض الضوابط، مع تمسكها بخطين أحمرين رئيسيين:

• عدم السماح باستخدام الذكاء الاصطناعي في المراقبة الجماعية للمواطنين داخل الولايات المتحدة.

• حظر تطوير أنظمة أسلحة قادرة على العمل بشكل مستقل دون تدخل بشري مباشر.

وترى الشركة أن هذه الضوابط تمثل التزامًا أخلاقيًا لا يمكن التراجع عنه، بينما يعتبر بعض مسؤولي الدفاع أن تلك القيود تعيق تطوير قدرات عسكرية متقدمة في ظل التنافس الدولي المتسارع في مجال الذكاء الاصطناعي.

تهديد بإجراءات صارمة

بحسب تسريبات، لوّحت وزارة الحرب بإمكانية تصنيف الشركة على أنها “خطر على سلسلة الإمداد الدفاعية”، وهو توصيف قد يؤدي إلى إنهاء العقود القائمة، بل وإلزام الشركات المتعاقدة مع الوزارة بإثبات عدم استخدامها نموذج «كلود» في عملياتها.

غير أن استبدال النموذج الحالي ليس أمرًا بسيطًا، إذ تشير التقديرات إلى أن البدائل المتاحة لا تزال أقل كفاءة في التطبيقات الحساسة المرتبطة بالدفاع والاستخبارات.

الشركة: دعم الأمن مع الالتزام بالمسؤولية

من جانبها، أكدت أنثروبيك أنها منخرطة في مناقشات بناءة، وأنها ملتزمة بدعم الأمن القومي الأمريكي عبر تقنيات متقدمة، مع الحفاظ على معايير استخدام مسؤولة تمنع توظيف التكنولوجيا في ممارسات قد تثير جدلاً قانونيًا وأخلاقيًا واسعًا.

معركة تتجاوز التقنية

المواجهة الحالية تعكس صراعًا أعمق بين متطلبات الأمن القومي وضوابط الاستخدام الأخلاقي للتكنولوجيا. فهي لا تتعلق فقط بنموذج ذكاء اصطناعي، بل بمستقبل العلاقة بين الدولة ومطوري التقنيات المتقدمة، وحدود ما يمكن قبوله في مجال عسكرة الذكاء الاصطناعي.

الاجتماع المرتقب قد يشكل نقطة تحول حاسمة: إما التوصل إلى تسوية توازن بين التفوق العسكري والمسؤولية الأخلاقية، أو دخول الطرفين في مواجهة قد تعيد رسم قواعد التعاون بين الحكومة الأمريكية وقطاع التكنولوجيا لسنوات طويلة قادمة.